Mapeamento de Recursos Digitais de Tecnologia Assistiva: Interação multimodal para pessoas com deficiência visual e cegas

Dominique Leite Adam Mestre em Design, Universidade Federal do Paraná, Curitiba, Paraná, Brasil. domiadam@gmail.com

Isabela Zarpellon Nascimento Graduanda em Engenharia Mecânica, Universidade Federal do Paraná, Curitiba, Paraná, Brasil. izarpellon26@gmail.com

Maria Lucia Leite Ribeiro Okimoto Drª em Engenharia, Universidade Federal do Paraná, Curitiba, Paraná, Brasil. lucia.demec@ufpr.br

Resumo: Com base nos princípios do Design Inclusivo, este artigo visa mapear recursos digitais de Tecnologia Assistiva (TA) que auxiliam a interação de pessoas com deficiência visual ou cegas com o computador, associando-os à abordagem multimodal. Para isso, foi realizada uma Revisão Bibliográfica Sistemática no Portal de Periódicos da CAPES, visando identificar pesquisas dos últimos 5 anos. A busca constatou estudos que citam, desenvolvem ou avaliam recursos digitais assistivos que associam outputs visuais, sonoros e hápticos. Como resultado, verifica-se o potencial da abordagem multimodal no desenvolvimento destes recursos, possibilitando uma interação inclusiva.

Palavras-chave: recursos assistivos; multimodalidade; interação-humano computador; deficiência visual.

Introdução

A inclusão de pessoas com deficiência visual e cegas é intermediada por recursos de Tecnologia Assistiva (TA). Em muitos casos, este termo é associado à ideia de produtos inovadores que envolvem a mais alta tecnologia. No entanto, de acordo com o Comitê de Ajudas Técnicas (BRASIL, 2009), sua definição engloba diversos conceitos que tangenciam a acessibilidade, não sendo unicamente pautada no avanço tecnológico:

Produtos, recursos, metodologias, estratégias, práticas e serviços que objetivam promover a funcionalidade, relacionada à atividade e participação, de pessoas com deficiência, incapacidades ou mobilidade reduzida, visando sua autonomia, independência, qualidade de vida e inclusão social (BRASIL, 2009, p. 9).

Esta definição insere os recursos de TA como elementos fundamentais para a promoção da acessibilidade nos mais variados ambientes, sejam físicos ou digitais. Tornar acessível um recurso digital – acessibilidade digital – é utilizar a TA para promover a flexibilidade do artefato, permitindo que ele se adeque às necessidades do usuário. Segundo Conforto e Santarosa (2002) a TA auxilia a interação em diferentes níveis do mundo digital, desde hardwares, ao garantir o acesso ao computador e periféricos, a softwares e interfaces, ao possibilitar o diálogo com sistemas, navegadores e websites, por exemplo. Passerino e Montardo (2007) complementam que, para alcançar a acessibilidade digital, são necessárias ferramentas e adaptações embutidas tanto nos hardwares quanto nos softwares. Possibilitar meios distintos de interação capazes de fornecer o acesso ao conteúdo (físico ou digital) é um direito adquirido por todos (BRASIL, 2015).

À vista disso, o presente artigo visa, por meio de um estudo exploratório, identificar recursos assistivos digitais que possibilitam a Interação Humano-Computador (IHC) acessível e discorrer a cerca da abordagem multimodal listando as possibilidades de interação provenientes de outputs sonoros e hápticos.

27IHC e Recursos de TA

A Interação Humano-Computador (IHC) é uma área do conhecimento que visa desenvolver e avaliar soluções tecnológicas (sob a ótica da usabilidade e acessibilidade) considerando todos os aspectos de interação dos usuários com as interfaces/sistemas (CARROL e KJELDSKOV, 2013). Neste cenário, as interfaces digitais são recursos que intermediam a interação, permitindo que o usuário e o computador, mesmo utilizando linguagens completamente diferentes, se comuniquem.

Para as pessoas com deficiência visual ou cegas, há uma série de recursos físicos, virtuais e digitais de TA que melhoram a qualidade de vida por possibilitarem a IHC por meio da estimulação sonora, hápticaO termo se refere na identificação de um ambiente ou objeto, físico ou virtual, por meio do tato e pela associação de aspectos cinestésicos (movimento e equilíbrio). Dessa forma é possível reconhecer a localização e posição no espaço, textura, superfície, temperatura, força e vibração (PARK e ALDERMAN, 2018) p. 261). e cinestésica. Dentre os hardwares assistivos evidenciam-se o computador, tablets, dispositivos móveis, wearables e periféricos hápticos. Entre os softwares, destacam-se os leitores de tela, sintetizadores de voz e recursos hápticos (PARK e ALDERMAN, 2018).

De acordo com Power et al. (2009) e Argyropoulos et al. (2019) a utilização de outputs sonoros como recursos assistivos pode ocorrer de duas formas: por meio da tecnologia dos leitores de tela, que traduzem a informação visual através de outputs sonoros sintetizados (text-to-speech), ou por meio de sistemas com o formato Digital Accessible Information System – DAISY, que fornecem a informação através de uma navegação sonora hierarquizada e sincronizada (speech recording).

Os recursos hápticos (tátil-vibracionais), segundo Caetano (2018) envolvem dispositivos capazes de oferecer output de força, textura, movimento e pressão. A utilização desses recursos visa criar sistemas que aproximam as sensações virtuais das físicas. Existem softwares que traduzem, por meio do código braille e suas variantes, um vasto grupo de materiais digitais. Textos, gráficos, imagens, símbolos, partituras musicais, notações matemáticas, entre outros podem ser acessados pela exploração háptica (POWER et al., 2009).

Design Inclusivo e Multimodal

O avanço tecnológico em torno dos recursos de TA tem contribuído para a inclusão de pessoas com deficiência visual ou cegas na sociedade. Sob a ótica do Design Inclusivo, é possível desenvolver e adaptar interfaces com o intuito de torná-las acessíveis para um maior número de indivíduos, independente de suas limitações cognitivas. Para isso, de acordo com estudos de Bataliotti (2017) é necessário seguir a abordagem de Design Centrado no Usuário (DCU) junto às diretrizes e recomendações de acessibilidade e usabilidade (W3C, 2008) para que os recursos digitais cumpram seus objetivos, garantindo a inclusão.

Ao projetar recursos de TA, é viável explorar as habilidades sensoriais dos potenciais usuários destes artefatos. A multimodalidade é um mecanismo amplamente utilizado para fomentar esta interação. De acordo com Park e Alderman (2018), ao explorar as modalidades visual, auditiva, háptica e cinestésica é possível elevar a capacidade de criação de mapas mentais dos ambientes em que estamos interagindo, sejam eles físicos ou virtuais, proporcionando interações e experiências mais significativas.

28A abordagem multimodal auxilia pessoas com deficiências, ao passo que a compensação da informação visual ocorre, principalmente, por meio da estimulação sonora e tátil. Ao associar outputs, a apresentação do conteúdo visual é substituída, complementada ou reforçada com base na necessidade do usuário (JAIMES; SEBE, 2007).

Conveniente ressaltar que para desenvolver um recurso multimodal é necessário compreender que a interação entre os sentidos humanos e os outputs dos recursos estão emparelhados e, de modo cíclico, fornecem feedback a todo momento. Assim, para que a IHC seja eficiente, ressalta-se a importância de mapear o fluxo de tarefas que podem ser realizadas, o tempo de aprendizagem, bem como a demanda e sobrecarga cognitiva (PARK e ALDERMAN, 2018).

Procedimentos Metodológicos

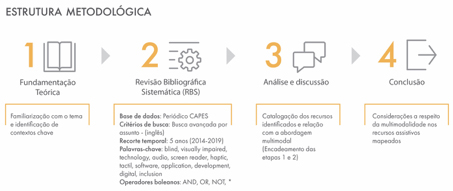

Para nortear o desenvolvimento deste artigo, foram definidas 4 etapas principais, conforme Figura 1. A etapa inicial visou a familiarização com o tema, identificando as bases teóricas para fundamentar a discussão. A etapa 2 consistiu em uma Revisão Bibliográfica Sistemática da Literatura (RBS) com base em Conforto et al. (2011). O objetivo da revisão foi mapear pesquisas científicas que citam e utilizam recursos digitais de TA para mediar a interação da pessoa com deficiência visual e a interface. A etapa 3 catalogou os recursos assistivos identificados a fim compreendê-los sob a ótica da abordagem multimodal. Por fim, a etapa 4 objetivou discorrer a cerca da abordagem multimodal em recursos digitais de TA, listando a relevância da multimodalidade para a inclusão digital.

A partir da literatura sobre recursos digitais de TA e interação (etapa 1), foram selecionados termos chave relacionados ao feedback auditivo e háptico, tecnologia, interfaces e pessoa com deficiência visual ou cega para dar início à RBS. Para esta etapa foram estabelecidos critérios de busca a partir da seleção da Base de dados – Periódicos da CAPES (CAPES, 2019). Ressalta-se que esta revisão visa identificar artigos revisados por pares e publicados nos últimos cinco anos, garantindo conteúdo pertinente e atualizado sobre o tema. Para isso, foi utilizado como filtro de busca, a “busca avançada”, que permite a inserção dos termos chave em campos diferenciados, como título, autor, assunto ou qualquer campo. Desta forma, os documentos foram filtrados a partir da relevância dos termos e suas associações, utilizando operadores booleanos. O operador AND fornece resultados contendo, necessariamente, um termo e o outro; OR gera resultados contendo um termo ou o outro; e o asterisco (*) permite que variações de uma determinada palavra (a partir de seus radicais) estejam contidas nos resultados. Ressalta-se que a busca foi realizada em dois momentos: A busca (a) objetivou selecionar recursos assistivos digitais com feedback sonoro, e a busca (b), visou identificar recursos assistivos digitais com feedback háptico. Além desses fatores, para atingir um resultado direcionado, foi determinado que os termos relacionados às características do público alvo deveriam estar contidos nos títulos dos documentos. O Quadro 1 apresenta as strings de busca utilizadas, bem como os resultados encontrados a partir dos critérios estabelecidos.

29| Strings de busca | ResultadoS | |

|---|---|---|

| (a) | Busca no campo título: blind* OR (visually impaired) Busca em qualquer campo: (audio OR (screen read*)) AND (software OR app OR application) AND development AND digital AND inclusion AND technolog* |

52 |

| (b) | Busca no campo título: blind* OR (visually impaired) Busca em qualquer campo: (haptic OR tactil*) AND (software OR app OR application) AND development AND digital AND inclusion AND technolog* |

31 |

| TOTAL | 83 | |

Análise dos Resultados

Os 83 documentos encontrados foram filtrados a partir da leitura dos títulos, palavras-chave e resumo, sendo eleitos aqueles que se enquadram ao tema da RBS. Deste modo, na busca com a string (a), dos 52 artigos encontrados, 26 foram selecionados por trazerem a abordagem de TA e interfaces. Destes, 13 estudos abordam softwares e aplicativos para mediar a IHC inclusiva, seja no aporte teórico ou no desenvolvimento. Da mesma maneira, a busca com a string (b) resultou em 31 documentos. Dentre eles, 15 foram escolhidos por corresponderem ao tema investigado, 4 deles já mapeados com a string (a), restando 11 documentos para a análise.

À vista disso, foram identificadas 24 pesquisas e 52 recursos digitais de TA que medeiam a IHC de pessoas com deficiência visual ou cegas. Os quadros 2, 3, 4, 5, 6, 7 e 8 apresentam a catalogação desses recursos por output sensorial, bem como os estudos em que são citados.

30| Recurso de TA | descrição | citado em | |

|---|---|---|---|

| SONORO | TalkBack | Software leitor de tela | O’Sullivan; et al. (2013); Damaceno et al. (2016); Costa e Duarte (2017) |

| JAWS | Software leitor de tela | Loiacono et al. (2012); Bidarra; Oyamada (2013); Fartaria et al. (2013); Baker; Green (2016); Costa e Duarte (2017); Maćkowski et al. (2018) | |

| NonVisual Desktop (NVDA) | Software leitor de tela | Fartaria et al. (2013); Baker; Green (2016); Maćkowski et al. (2018) | |

| Leitor de tela programado em Python | Software leitor de tela | Bidarra; Oyamada (2013) | |

| VoiceOver | Software leitor de tela | Guerreiro (2015); Ghidini et al. (2016); Costa e Duarte (2017) | |

| All Appointments | Aplicativo de calendário para pessoas com deficiência visual | Ghidini et al. (2016) | |

| AudioBrowser | Software que permite a IHC por meio de comandos e feedbacks sonoros | Hakobyan et al. (2013) | |

| IVONA (substituído pelo Amazon Polly) | Técnica de sintetização da fala humana, que converte texto em output sonoro | Costa e Duarte (2017) | |

| MathPlayer, MathReader | Software matemático que lê fórmulas escritas em MathML e nos DAISY Books | Depountis et al. (2015); Maćkowski et al. (2018) | |

| Speed Rule Engine | Software que converte fórmulas escritas em MathML para textos que podem ser lidos por leitores de tela convencionais | Maćkowski et al. (2018) | |

| Window-eyes | Software leitor de tela | Maćkowski et al. (2018) | |

| MathSpeak | Sistema usado por leitores de tela para ler expressões matemáticas, como aquelas escritas em MathML | Depountis et al. (2015) | |

| ClickHear | Software de audiodescrição para internet | Depountis et al. (2015) | |

| mBRAILLE | Software que transpõe o sistema de escrita braile para interfaces digitais | Nahar et al. (2015) | |

| VIRTUAL VISION | Software de assistência sonora que possibilita a interação com os recursos computacionais | Carlos; De Sá (2018) | |

| BlindHelper | Software de mobilidade e navegação autônoma em museus | Meliones; Sampson (2018) | |

| GOBLIN | Software sintetizador de voz | Hudec; Smutny (2017) | |

| Music Reader | Software leitor de partituras musicais | Baker; Green (2016) | |

| Mobile Speak | Software leitor de telas | Baker; Green (2016) | |

| The vOICe project | Sistema que traduz imagens para sons | Lahav et al. (2018) | |

| CARA | Sistema de assistência domiciliar, locomoção | Liu et al. (2018) | |

| Microsoft HoloLens | Sistema de assistência a mobilidade baseado em realidade virtual | Liu et al. (2018) | |

| IC2D | Sistema para desenho digital | Mukherjee et al. (2014) |

| Recurso de TA | Descrição | Citado em | |

|---|---|---|---|

| VISUAL | iZoom, MAGIC, SuperNova, ZoomText | Software de visualização e ampliação | Baker; Green (2016) |

| RECURSO DE TA | DESCRIÇÃO | CITADO EM | |

|---|---|---|---|

| HÁPTICO | Slide Rule | Sistema de interação baseada em gestos de deslizamentos na tela | Hakobyan et al. (2013); Damaceno et al. (2016) |

| UbiBraille | Conjunto de software e hardware que permite a leitura de caracteres em braille por meio de vibração | Guerreiro (2015) | |

| HoliBraille | Conjunto de software e hardware que permite a interação com dispositivos móveis por meio de vibrações | Guerreiro (2015) |

| Recurso de TA | Descrição | Citado em | |

|---|---|---|---|

| VISUAL E SONORO | xLupa | Aplicativo para Linux que inclui ampliador e leitor de tela e calibragem de vídeo | Bidarra; Oyamada (2013) |

| NavMol 2.0 | Software educativo que visa o ensino de química a pessoas com deficiência visual | Fartaria et al. (2013); Lahav et al. (2018) | |

| MAPVOICE | Software para auxílio na aprendizagem da Cartografia | Carlos; De Sá (2018) | |

| IVEO Viewer | Software de visualização e ampliação de imagens | Mukherjee et al. (2014) |

| Recurso de TA | Descrição | Citado em | |

|---|---|---|---|

| SONORO E HÁPTICO | Foogue | Um sistema de IHC que utiliza recursos sonoros e hápticos | Hakobyan et al. (2013) |

| MoBraille | Hardware que permite a leitura e a digitação de caracteres em smartphones | Hakobyan et al. (2013) | |

| Lambda | Software que converte fórmulas matemáticas em sinais a serem lidos por alguns dispositivos com feedback háptico | Maćkowski et al. (2018) | |

| Braille note-taker | Hardware para o registro de informações e posterior impressão em braille | Baker; Green (2016) | |

| Talking Tactile Tablets | Hardware para visualizar gráficos e imagens | Mukherjee et al. (2014); Lahav et al. (2018) | |

| Line Graphs Technology | Sistema para o aprendizado de matemática | Lahav et al. (2018) | |

| TDraw | Software que transpõe o desenho feito pela caneta digitalizadora para a tela | Mukherjee et al. (2014) | |

| Touch Tiles | Software para o ensino de geometria | Mukherjee et al. (2014) | |

| Audio Tact | Software matemático (funções e gráficos) | Mukherjee et al. (2014) | |

| Sparsha System | Sistema de tradução da língua Indiana para o braille (impresso) | Mukherjee et al. (2014) | |

| Qiktac | Software para criação de gráficos para serem impressos (emboss) | Mukherjee et al. (2014) |

| Recurso de TA | Descrição | Citado em | |

|---|---|---|---|

| VISUAL E HÁPTICO | Servidor tátil programado em linguagem C | Servidor táctil programado em C que se comunica com um pequeno motor no mouse e o faz vibrar | Bidarra; Oyamada (2013) |

| Wiimote | Controle do videogame Wii, da Nintendo | Costa e Duarte (2017) |

| Recurso de TA | Descrição | Citado em | |

|---|---|---|---|

| SONORO, VISUAL E HÁPTICO | V-Braille | Software que permite a leitura de caracteres (célula braile) por meio de vibrações e feedback sonoro (text-to-speech) | Hakobyan et al. (2013) |

| SensiTV | Plataforma que utiliza luz, vibrações e música de fundo para expressar emoções contidas em filmes | Costa e Duarte (2017) | |

| IVEO | Conjunto de software e hardware que permite a leitura de desenhos e diagramas impressos em relevo | Mukherjee et al. (2014); Depountis et al. (2015); Maćkowski et al. (2018) |

Em tese, há uma enorme preocupação em tornar a IHC mais adequada ao usuário, seja por meio da utilização de outputs sonoros, hápticos ou visuais (para aqueles com baixa visão, por exemplo). Em geral, foi possível observar diferentes abordagens sobre os recursos digitais de TA que facilitam a interação, estas diretamente relacionadas aos objetivos das pesquisas mapeadas. Alguns estudos trazem apenas referências de softwares/hardwares assistivos (BAKER e GREEN, 2016; LAHAV et al., 2018), outros abordam o desenvolvimento de soluções de TA (FARTARIA et al., 2013; GHIDINI et al., 2016; HUDEC e SMUTNY, 2017; LIU et al., 2018), ou ainda a avaliação destas por meio de estudos experimentais (KUMAR e SANAMAN, 2015; GUERREIRO, 2015; DAMACENO et al., 2016) a fim de comprovar sua eficácia e eficiência na mediação da IHC de pessoas com deficiência visual ou cegas.

De modo geral, os recursos de TA detectados auxiliam em diversas atividades, seja na navegação com o meio digital e tarefas cotidianas (All Appointments, Audio Browser, Sensi TV, DOSVOX , Click Hear), no desenvolvimento e interpretação de imagens e gráficos (IVEO, vOICe Project, IC2D, TDraw, Touch Tiles, QikTac); no ensino-aprendizagem de matemática (MathPlayer, MathReader, MathSpeak, Lambda, Speed Rule Engine), química (NavMol 2.0), cartografia (Map Voice), braille (V-Braille, MoBraille, UbiBraille,HoliBraille, mBraille), música (Music Reader), como também no deslocamento e navegação em ambientes físicos (Blind Helper, CARA, Microsoft HoloLens).

A Figura 2 ilustra os recursos a partir de seu output de interação. É possível observar que dos 52 recursos digitais de TA, a maioria (n=43) apresenta output sonoro, como os sintetizadores de voz (e.g. NavMol 2.0, GOBLIN) e leitores de tela (e.g. JAWS, NVDA, Voice Over, Window-eyes, Molibe Speak). Isso pode ser justificado pelo fato da audição ser a habilidade sensorial primária desenvolvida pelas pessoas com deficiência visual ou cegas (TAKAGI et al., 2007).

Na sequência, 13 recursos apresentam output visual, sendo que apenas 3 são demostrados em uma única modalidade (ampliadores de tela). Em relação ao output háptico, por meio de feedback de força ou vibração, foram identificados 19 recursos assistivos, como por exemplo o Side Rule, Servidor Tátil programado em linguagem C e o Braile note-taker. Assim como os recursos somente visuais, o output háptico é normalmente associado a outra modalidade, a fim de complementar e reforçar a interação – abordagem multimodal (JAIMES e SEBE, 2007).

Nota-se que cerca de 38% dos recursos mapeados possuem a abordagem multimodal associando ao menos dois outputs sensoriais distintos. Estudos indicam que as interações multimodais – visual-sonora (e.g xLupa, MAPVOICE, IVEO Viewer, NavMol 2.0); visual-háptica (e.g. Servidor tátil programado em linguagem C , Wiimote) e visual-sonora-háptica (e.g. SensiTV, IVEO, V-Braille) tendem a favorecer a IHC ao passo que proporcionam o acesso inclusivo à interface (HAKOBYAN et al., 2013; MUKHERJEE et al., 2014; COSTA e DUARTE, 2017).

34Neste contexto ressalta-se a tríade multimodal. Embora identificada em apenas três recursos assistivos, a associação de outputs sonoros, visuais e hápticos apresenta grande potencial para mediar uma a interação inclusiva, independente do objetivo e do contexto em que ocorre. O V-Braille, por exemplo, é capaz de integrar os outputs sensoriais a fim de ensinar a linguagem braile de forma objetiva (compreensão de caracteres, leitura e escrita) e lúdica (por meio de jogos) para pessoas com ou sem deficiência visual. Já o Sensi-TV apresenta uma abordagem multimodal para o entretenimento, que possibilita a tradução de emoções contidas em filmes. A interação pode acontecer por meio da associação visual (e.g. imagens, legenda, variação de luminosidade), tátil (e.g. frequências de vibrações) e sonoro (e.g. padrões musicais), resultando em experiências ricas e inclusivas. Por fim, o recurso IVEO permite a transposição de conteúdos visuais (digitais ou não) em informações sonoras (leitor de tela) e táteis (interação háptica). Este recurso apresenta grande potencial para ser utilizado no aprendizado de conteúdos imagéticos (e.g. mapas, gráficos, ilustrações e esquemas visuais), pois possibilita a exploração visual e tátil de figuras, seguida de informações sonoras que descrevem a área percebida (e.g. legenda, descrição sonora).

Discussão e Considerações

É possível constatar que a maioria dos recursos identificados fornecem o output sonoro, vindo de encontro com a habilidade sensorial melhor desenvolvida pelas pessoas com deficiência visual. Como complemento para a interação, nota-se que muitos recursos apresentam mais de um modo de fornecimento de dados, confirmando o potencial da multimodalidade para desenvolver e/ou adaptar interfaces e sistemas, tornando-os perceptíveis a um maior número de indivíduos.

Simultaneamente, observa-se a cerca das limitações econômicas, tecnológicas, projetuais e de implementação desses recursos digitais de TA. Considerando a sociedade brasileira, nota-se que estes recursos são direcionados a um nicho específico de mercado que, muitas vezes, requerem um elevado custo de implementação e treinamento para o uso, levando-os à obsolência. Em contrapartida, estes fatores motivam pesquisadores a proporem as melhores soluções, personalizadas muitas vezes, a partir das condições a eles fornecidas.

A partir deste estudo conclui-se que a multimodalidade está em constante evolução e é amplamente utilizada em recursos assistivos. A partir dos estudos mapeados é possível inferir que ao aliar as necessidades dos usuários à tecnologia, comprova-se a oportunidade de explorar a associação sensorial para promover uma IHC inclusiva em recursos digitais de TA. Constatou-se que ao fornecer mais de um output sensorial, maior é a possibilidade de este recurso ser inclusivo. Contudo, reitera-se a necessidade de, ao desenvolver um recurso assistivo multimodal, considerar a abordagem do Design Centrado no Usuário a fim de adequar as funções aos objetivos de interação, com o intuito de evitar a sobrecarga cognitiva. À vista disso, amplia-se o diálogo do indivíduo com o mundo, permitindo que as informações textuais, imagéticas, audiovisuais ou cinestésicas, sejam apreeendidas através dos sentidos mais desenvolvidos.

Desta forma, conclui-se que a multimodalidade tem o potencial de fornecer experiências de interação mais ricas e não exclusivas às pessoas com deficiência. A interação proporcionada influencia na qualidade de vida, independência e inclusão de todos à sociedade.

35Referências

ARGYROPOULOS, V.; PAVELI, A.; NIKOLARAIZI, M. The role of DAISY digital talking books in the education of individuals with blindness: A pilot study. Education and Information Technologies, v. 24, n. 1, p. 693–709, 2019. Disponível em: https://doi.org/10.1007/s10639-018-9795-2. Acesso em: 14/6/2019.

BAKER, D.; GREEN, L. Perceptions of schooling, pedagogy and notation in the lives of visually-impaired musicians. Research Studies in Music Education, v. 38, n. 2, p. 193–219, 2016. Disponível em: http://vimusicians.ioe.. Acesso em: 14/6/2019.

BATALIOTTI, S. E. Da acessibilidade à autonomia do usuário com deficiência visual em ambientes virtuais de aprendizagem, 2017. Universidade Estadual Paulista.

BIDARRA, J.; OYAMADA, M. S. Development of an Interactive Kiosk with Screen Amplifier for the Elderly and Those with Low Vision. , v. 45, n. 2, p. 117–133, 2013.

BRASIL, C. DE A. T. Tecnologia Assistiva. Brasília, 2009.

BRASIL, P. DA R. Lei Brasileira de Inclusão da Pessoa com Deficiência. 2015.

CAETANO, A. C. M. Interfaces hápticas dispositivos não convencionais de interação. Anais do 7o Encontro Internacional de Arte e Tecnologia. 2018. Brasilia.

CAPES, C. DE A. DE P. DE N. S. Portal de Periodicos da CAPES. Disponível em: http://www.periodicos.capes.gov.br/. Acesso em: 17/6/2019.

CARLOS, L. B.; DE SÁ, L. A. C. M. MAPVOICE: Ferramenta Computacional para Auxílio na aprendizagem da Cartografia para Deficientes Visuais. Bulletin of Geodetic Sciences, v. 24, p. 58–68, 2018. Disponível em: http://english.tse.jus.br/arquivos/federal-constitution/view.. Acesso em: 14/6/2019.

CARROL, J. M. .; KJELDSKOV, J. 2. Human Computer Interaction. The Encyclopedia of Human-Computer Interaction, 2013. Addison-Wesley Pub. Co. Disponível em: https://www.interaction-design.org/literature/book/the-encyclopedia-of-human-computer-interaction-2nd-ed/human-computer-interaction-brief-intro. Acesso em: 16/6/2019.

CONFORTO, D.; SANTAROSA, L. M. C. Acessibilidade à web : internet para todos. Revista de Informática na Educaçao: Teoria, Prática, v. 5, p. 87–102, 2002. Disponível em: http://edu3051.pbworks.com/f/ACESSIBILIDADE_WEB_revista_PGIE.pdf.

CONFORTO, E. C.; AMARAL, D. C.; LUIS DA SILVA, S. Roteiro para revisão bibliográfica sistemática: aplicação no desenvolvimento de produtos e gerenciamento de projetos. 8o Congresso Brasileiro de Gestão de Desenvolvimento de Produto CBGDP. Anais..., 2011. Porto Alegre. Disponível em: http://vision.ime.usp.br/~acmt/conforto.pdf. Acesso em: 12/6/2019.

COSTA, D.; DUARTE, C. Visually impaired people and the emerging connected TV: a comparative study of TV and Web applications’ accessibility. Universal Access in the Information Society, v. 16, n. 1, p. 197–214, 2017. Disponível em: http://link.springer.com/10.1007/s10209-016-0451-6. Acesso em: 13/9/2018.

36DAMACENO, R. J. P.; BRAGA, J. C.; CHALCO, J. P. M. Mobile Device Accessibility for the Visually Impaired. Proceedings of the 15th Brazilian Symposium on Human Factors in Computer Systems - IHC ’16, October 2017, p. 1–10, 2016. Disponível em: http://dl.acm.org/citation.cfm?doid=3033701.3033703.

DEPOUNTIS, V. M.; POGRUND, R. L.; GRIFFIN-SHIRLEY, N.; LAN, W. Y. Technologies Used in the Study of Advanced Mathematics by Students Who Are Visually Impaired in Classrooms: Teachers’ Perspectives. Journal of Visual Impairment & Blindness, 2018, v.109, p-265-278 .

FARTARIA, R. P. S.; PEREIRA, F.; BONIFÁCIO, V. D. B.; et al. NavMol 2.0 - A Molecular Structure Navigator/Editor for Blind and Visually Impaired Users. European Journal of Organic Chemistry, v. 2013, n. 8, p. 1415–1419, 2013. Wiley-Blackwell. Disponível em: http://doi.wiley.com/10.1002/ejoc.201201458. Acesso em: 27/9/2018.

GHIDINI, E.; ALMEIDA, W. D. L.; MANSSOUR, I. H.; SILVEIRA, M. S. Developing Apps for Visually Impaired People : Lessons Learned from Practice. , 2016.

GUERREIRO, T. Accessibility layers. ACM SIGACCESS Accessibility and Computing, n. 113, p. 22–28, 2015.

HAKOBYAN, L.; LUMSDEN, J.; BARTLETT, H. Mobile assistive technologies for the visually impaired. Survey of Ophthalmology, v. 58, p. 513–528, 2013. Disponível em: http://dx.doi.org/10.1016/j.survophthal.2012.10.004. Acesso em: 2/10/2018.

HUDEC, M.; SMUTNY, Z. RUDO: A home ambient intelligence system for blind people. Sensors (Switzerland), v. 17, n. 8, 2017.

JAIMES, A.; SEBE, N. Multimodal human–computer interaction: A survey. Computer Vision and Image Understanding, v. 108, n. 1–2, p. 116–134, 2007. Disponível em: www.elsevier.com/locate/cviu. Acesso em: 26/2/2019.

KUMAR, S.; SANAMAN, G. Web challenges faced by blind and vision impaired users in libraries of Delhi. The Electronic Library, v. 33, n. 2, p. 242–257, 2015. Disponível em: https://doi.org/10.1108/EL-03-2013-0043. Acesso em: 27/9/2018.

LAHAV, O.; HAGAB, N.; EL KADER, S. A.; LEVY, S. T.; TALIS, V. Listen to the models: Sonified learning models for people who are blind. Computers & Education, v. 127, p. 141–153, 2018. Disponível em: https://linkinghub.elsevier.com/retrieve/pii/S0360131518302240. Acesso em: 15/6/2019.

LIU, Y.; STILES, N. R.; MEISTER, M. Augmented reality powers a cognitive assistant for the blind. eLife, v. 7, 2018. Disponível em: https://elifesciences.org/articles/37841. Acesso em: 14/6/2019.

LOIACONO, E. T.; DJAMASBI, S.; KIRYAZOV, T. Factors that affect visually impaired users’ acceptance of audio and music websites. Journal of Human Computer Studies, v. 71, p. 321–334, 2012. Disponível em: www.sciencedirect.com.

MAĆKOWSKI, M. S.; BRZOZA, P. F.; SPINCZYK, D. R. Tutoring math platform accessible for visually impaired people. Computers in Biology and Medicine, v. 95, p. 298–306, 2018. Disponível em: http://dx.doi.org/10.1016/j.compbiomed.2017.06.003. Acesso em: 3/10/2018.

37MELIONES, A.; SAMPSON, D. Blind MuseumTourer: A System for Self-Guided Tours in Museums and Blind Indoor Navigation. Technologies, v. 6, n. 1, p. 4, 2018.

MUKHERJEE; GARAIN, U.; BISWAS, A. Experimenting with Automatic Text-to-Diagram Conversion: A Novel Teaching Aid for the Blind People. Educational Technology & Society, v. 17, n. 3, p. 1176–3647, 2014. Disponível em: https://pdfs.semanticscholar.org/a5cc/c65fa79b6e8a4f16c667ee1c76ff0c27a4e3.pdf?_ga=2.171031653.479329528.1560638669-2146878616.1548338717. Acesso em: 15/6/2019.

NAHAR, L.; JAAFAR, A.; AHAMED, E.; KAISH, A. B. M. A. Design of a Braille Learning Application for Visually Impaired Students in Bangladesh. Assistive Technology, v. 27, n. 3, p. 172–182, 2015. Disponível em: http://www.tandfonline.com/doi/full/10.1080/10400435.2015.1011758.

PARK, C. W.; ALDERMAN, J. Designing across senses : a multimodal approach to product design. 1o ed. Sebastopol: O’Rilley Media, Inc, 2018.

PASSERINO, L. M.; MONTARDO, S. P. Inclusão Digital e Acessibilidade Digital: Interfaces e aproximações conceituais. XVI Encontro da Compós - Associação Nacional dos Programas de Pós-Graduação em Comunicação. Anais..., 2007. Curitiba. Disponível em: http://redessociaiseinclusao.pbworks.com/f/ID-acess_compos_2007_versão final.pdf. Acesso em: 17/6/2019.

POWER, C.; JÜRGENSEN, H.; JU, H.; JURGENSEN, H. Accessible presentation of information for people with visual disabilities. Universal Access in the Information Society, v. 9, n. 2, p. 97–119, 2009. Disponível em: http://link.springer.com/content/pdf/10.1007/s10209-009-0164-1.pdf. Acesso em: 3/4/2013.

TAKAGI, H.; SAITO, S.; FUKUDA, K.; ASAKAWA, C. Analysis of navigability of Web applications for improving blind usability. ACM Transactions on Computer-Human Interaction, v. 14, n. 3, p. 13- es, 2007. ACM. Disponível em: http://portal.acm.org/citation.cfm?doid=1279700.1279703. Acesso em: 17/6/2019.

W3C. Web Content Accessibility Guidelines (WCAG) 2.0. Disponível em: https://www.w3.org/TR/WCAG20/. Acesso em: 31/1/2018.